2018/06/11

1768

人工智能发展上的起起落落

人工智能的历史其实正好与计算机的历史差不多一样长,但两者的发展进度却大相径庭。一个很像一帆风顺的富二代,一个则起起落落很像白手起家的创业者。

我们都知道现代计算机(包含我们常见的电脑、手机等)其实开始于图灵这个人。图灵在数学上证明了如果处理盒(相当于处理器)选择了一套正确的规则,并给予无限长的纸带(相当于内存和硬盘),那么这种装置可以进行任何宇宙里可以定义的操作,此后才由冯·诺依曼确定了计算机的基本体系结构,最终才是最近30年计算机的蓬勃发展。

不管看到的电子产品多么神奇,其实原理都来自上面这么个简单的东西。

这就和很多科技发展所遵循的规律一样,一个伟大的人物先在理论上达成一个自洽的、让人仰望的高度,后人则在这个大框架下不断细化和应用。牛顿的定律是这样,爱因斯坦的相对论是这样,计算机也是这样,但很不幸人工智能则不是这样,科学家始终还处在摸索中,只不过摸到的东西确实越来越多了。

人工智能也诞生于图灵那个年代,甚至也就是图灵这个人提出了今天引起了极大关注的那些方向,比如图灵测试、机器学习、遗传算法和强化学习等。但此后人工智能的发展则是三起两落,既有万众瞩目,人们信心爆棚,资金大量注入的时候,也有被打入冷宫、无人问津的时候。这与计算机乃至互联网的发展完全不一样,这两个东西在摩尔定律的助推下,很像是安了天使翅膀的人类,几乎是一路向前狂奔,到现在也还没怎么减速。这里面也许最根本的差别就是人工智能本身并没有一种理论基础,所以怀疑它不行或者相信它肯定能行都很像一种信念。信念在受到事实威胁时实在不足以支撑这样一个极其费钱的大科目,这就导致了人工智能的发展起起落落,一波三折。

人工智能的起点要追溯到大概60年前。1956年,当时这个领域非常有影响力的约翰·麦肯锡说服了明斯基、香农等人,帮助他把全美所有自动机理论、神经网络和智能研究的人召集到了一起,这年夏天,他们在达特茅斯组织了一场研讨会,从这场会议的声明中可以看出那时候的科学家对人工智能持何种乐观态度:

那时候的顶级科学家其实希望迅速地做完图灵对计算机所做的事情,但很不幸,事情的进展和他们想的完全不一样,并且可以确定到2016年夏天,也就是60年后,这事也还没搞定。但这次会议的特别价值在于它形成了一种共识——让人工智能成为一个独立的学科,因此这个会议通常被看成是人工智能这一学科真正诞生的标志。

人工智能是在人们信心大爆棚时诞生的,尽管科学家非常乐观,也声称自己的程序能够证明《数学原理》第2章中的大部分定理,但大多数人并不能从这一乐观态度中看到什么明显的进步。当时美国政府对此非常热心,在这个领域投了很多钱,与之相反英国政府却采取了一种完全不同的做法,他们请了一位著名的数学家——詹姆斯·莱特希尔(Sir James Lighthill)教授,对人工智能做一个彻底的评估。这位教授在看了所有重要的相关论文后,写出了一份报告,后来世人称之为《莱特希尔报告》。这份报告说人工智能绝不可能有什么用途,因为它只能被用来解决简单的问题。英国政府以后没有在人工智能上进行大量的投资,此后人工智能逐渐变得少有人问津。事实上第一波人工智能浪潮止步于以下三种困难:

第一种困难是早期的人工智能程序对句子的真实含义完全不理解,它们主要依赖于句法处理获得成功。这样一来,它们“the spirit is willing but the flesh is weak”(英文:心有余而力不足)到“the vodka is good but the meat is rotten(俄语:伏特加酒是好的,而肉是烂的)的英译俄再俄译英就不可能做对。其实直到现在问题仍然存在,只不过大量的数据弥补了不理解真实含义的缺陷。形象地讲,现在计算机并不去理解这个句子,而是看哪种翻译被用得多。

第二种困难则是《莱特希尔报告》里重点强调的组合爆炸。这导致让程序每次产生一个小变化,最终产生出可以解决问题的程序这种思路被堵死了。这就好比用试错法寻找正确的路,但每条路上都有无数的岔路甚至岔路间还彼此勾连,因此可走的路近乎无限多,那么试错法毫无价值。

第三种困难则是那时候发现虽然人工智能具有的神经网络简单形式可以学会它们能表示的任何东西,但它其实只能表示很少的东西,应用范围十分有限。

正因为这些困难得不到有效的解决,在20世纪70年代人工智能渐渐冷却,直到专家系统的兴起和神经网络让人们看到了新的希望。到了80年代确实有些专家系统被成功部署,并为公司节约了数以千万美元计的费用,比如第一个成功的商用专家系统R1在DEC成功运转,此后DEC陆续部署了40个专家系统。也正是在这时候日本宣布了第五代计算机计划,希望用10年时间研制出智能计算机。作为回应,美国也组建了一家公司来保证国家竞争力。

也是在这个时候,神经网络上取得了新的进展,一个典型的事件是1989年,燕乐存(Yann LeCun)在AT&T Bell实验室验证了一个反向传播在现实世界中的杰出应用,即“反向传播应用于手写邮编识别”系统,简单点说就是这个系统能很精准地识别各种手写的数字,很有意思的是当年的演示视频被保留了下来,所以我们今天仍然可以清楚地回放当年的效果。但很不幸的,展开这类算法所需要的计算能力和数据那时候并不具备,所以在实际应用中也逐渐败下阵来。这个方向狼狈到这样一种程度:现在的深度学习领军人物以及他们学生的论文被拒成了家常便饭,根本原因就是论文主题是神经网络。另一件小事也可以从侧面说明当时神经网络不被待见的程度:为了让神经网络复兴并被大家接受,现在鼎鼎大名的杰弗里·欣顿(Geoffrey Hinton)和它的小组密谋用“深度学习”来重新命名让人闻之色变的神经网络领域。很多人很难想到今天鼎鼎大名的深度学习其实是这么来的。

于是人工智能再次陷入低潮,这种低潮从其他方面解释其实是无意义的,主要还是技术本身的实现程度支撑不起足够多的应用。当一种技术并没有在商业中深度渗透进去,自身又需要较多的研究资源,也没有坚实的理论基础让人看到高额投入肯定会产生效果时,那么它遇冷的可能性就变得极大。

人工智能被低估持续了十几年,直到最近互联网和云计算的兴起。如果要从2010年时任斯坦福大学教授的吴恩达加入谷歌开发团队XLab开始计算,那这次的热潮兴起也不过只有五六年。互联网和云计算之所以让深度学习得以复兴,其关键点有两个:一是互联网提供了海量的数据;二是云计算提供了远超以往的计算能力。这两点很像燃料与引擎,它们叠加到一起就可以让车跑得飞快。

总结起来,我们可以讲到现在为止人工智能历经三起两落,和前两次不一样的是,这次我们有理由相信人工智能会发展起来而不是再落下去,关键原因不在于科学家如何有信心,而在于这种技术已经非常普遍地得到了应用,其应用范围要远大于前两次,不管是在声音、图像还是在数据分析上。

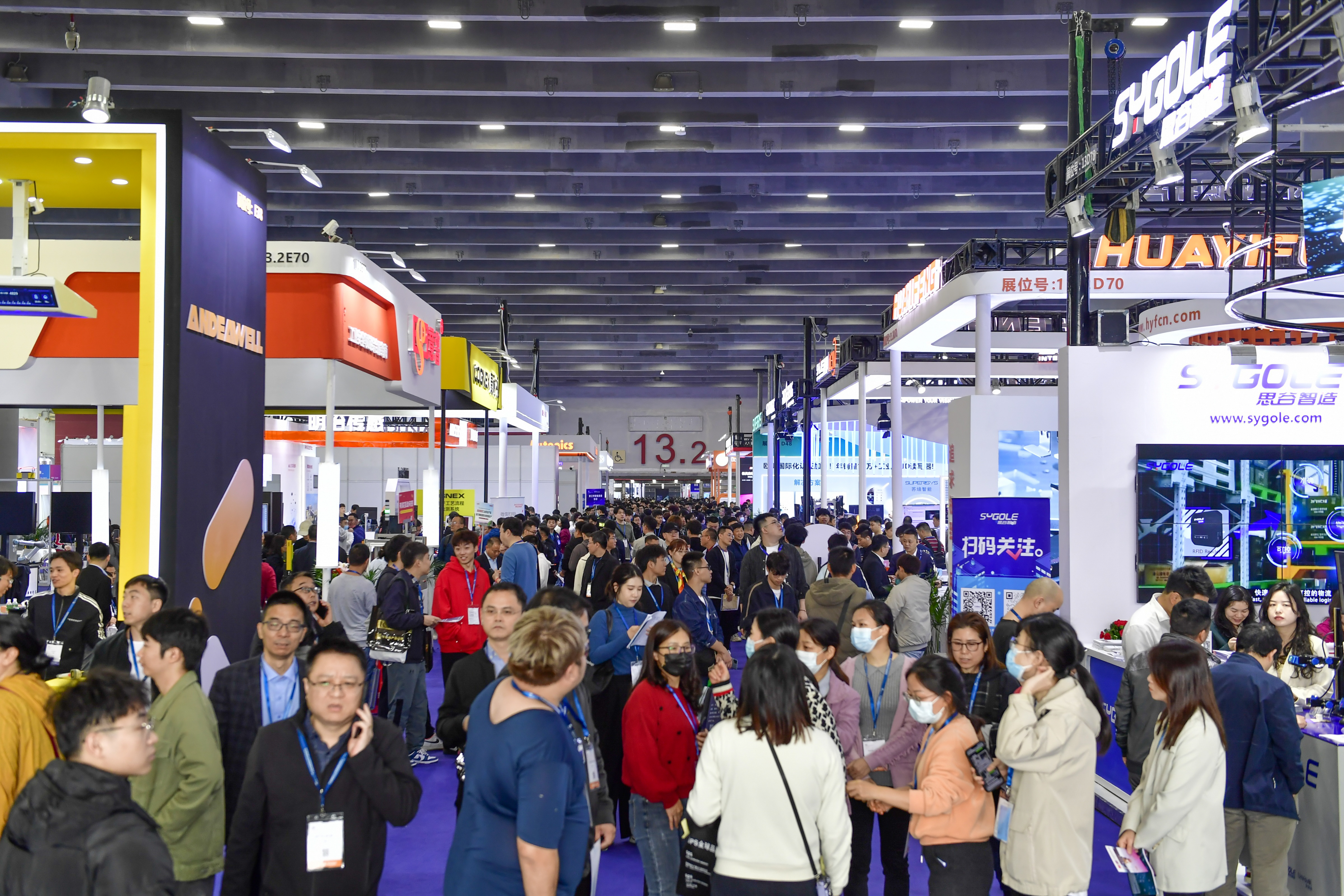

深耕自动化,成就多元产业应用

欢迎莅临广州国际智能制造技术与装备展览会!

主办单位官方微信